.png)

Autenticidad y detección de IA

9 de abril de 2024

Ley europea sobre IA: Etiquetado obligatorio de contenidos generados por IA

LECTURA RÁPIDA

<div class="hs-cta-embed hs-cta-simple-placeholder hs-cta-embed-148431706223"

style="max-width:100%; max-height:100%; width:170px;height:570.703125px" data-hubspot-wrapper-cta-id="148431706223">

<a href="https://cta-service-cms2.hubspot.com/web-interactives/public/v1/track/redirect?encryptedPayload=AVxigLJrUZ4Wxh0Qdo01FJ4Q3Oz5oJ8RUjWzxCE%2BkELt17Qi2%2BAAgPkuS8Pt33eRL3Zai2iDrxc%2FuuXDvNXR%2BItXjwgeAhIXwgNyEvtavhEWQ1W%2B3kCeRwLJYI0D0JQDHo%2F0khIj%2FAZrBa0oo%2F%2BIZ6ECmgP4hWoacTzMsQhF5Lrsykdo2Mj93DVdYAiPwA2cdnSRc5KmPlLxe7GX8sRN3ji8mITa6cPIJhWFgcXNP4z9K5TzbvTAVkNT04SmM8LpLg%3D%3D&webInteractiveContentId=148431706223&portalId=4144962" target="_blank" rel="noopener" crossorigin="anonymous">

<img alt="History of Digital Watermarking Download our infographic "the Invisible Digital Watermarking Saga: A Journey Through Time"" loading="lazy" src="https://no-cache.hubspot.com/cta/default/4144962/interactive-148431706223.png" style="height: 100%; width: 100%; object-fit: fill"

onerror="this.style.display='none'" />

</a>

</div>

Comparte este artículo

Suscríbete al blog

Me suscriboDescubra el nuevo requisito de la Ley Europea de Inteligencia Artificial para el etiquetado transparente de los contenidos generados por IA. Descubra cómo la tecnología de marca de agua digital desempeña un papel clave en la distinción de los medios sintéticos y explore las implicaciones para los proveedores de IA y la lucha contra las falsificaciones profundas.

La Ley Europea de Inteligencia Artificial ("AI ACT") fue aprobada por el Parlamento Europeo el 13 de marzo y entrará en vigor en mayo de 2024, 20 días después de su publicación en el Diario Oficial de la UE. Las prohibiciones sobre los sistemas de IA que se considere que plantean "riesgos inaceptables" entrarán en vigor seis meses después (noviembre de 2024), las normas de gobernanza y las obligaciones para los modelos de IA de uso general se aplicarán al cabo de 12 meses (mayo de 2025), y la plena aplicación está prevista al cabo de 24 meses (mayo de 2026).

Esta ley se aplica globalmente a todos los sistemas de inteligencia artificial, excluidos los utilizados para la investigación científica y en el sector militar, siempre que estén disponibles en el territorio de la Unión Europea.

Planteamiento general del AI ACT

La ley regula los sistemas de IA mediante un enfoque basado en el riesgo, definiendo cuatro niveles de riesgo para los sistemas de IA, cada uno con prohibiciones y obligaciones específicas:

Los sistemas de IA generativa se consideran sistemas de riesgo limitado

Entre los diversos sistemas de IA, los sistemas de inteligencia artificial generativa se definen en el apartado 2 del artículo 50 como: "sistemas de IA, incluidos los sistemas de IA de propósito general, que generan contenidos de tipo sintético como audio, imágenes, vídeos o texto". Algunos ejemplos de estos sistemas son Project Music GenAI Control de Adobe para la generación de audio, Midjourney para la creación de imágenes, Sora de OpenAI para la producción de vídeo y el generador de texto Claude de Anthropic. Estos sistemas están clasificados como sistemas de inteligencia artificial de riesgo limitado con arreglo a la AI ACT y están sujetos a requisitos de transparencia, como la obligación de informar a los usuarios de que la IA ha generado el contenido.

Los modelos de IA generativa más potentes y multimodales (capaces de generar cualquier tipo de contenido), como ChatGPT de OpenAI o Gemini de Google, se consideran sistemas de IA de propósito general que podrían provocar un riesgo sistémico. Están sujetos, además de a obligaciones de transparencia, a evaluaciones detalladas y pruebas de adversarios para prevenir cualquier incidente significativo que pudiera tener consecuencias adversas, como la producción de contenidos ilegales.

Obligación de transparencia: Etiquetado obligatorio de contenidos generados por IA

Todos los proveedores de sistemas de IA generativa, independientemente de su ubicación, tamaño, potencia o naturaleza, ya sean abiertos (libres y de código abierto) o propietarios, deben cumplir unas obligaciones fundamentales de transparencia. Estas permiten al público saber si el contenido ha sido generado artificialmente y distinguirlo del auténtico contenido generado por humanos.

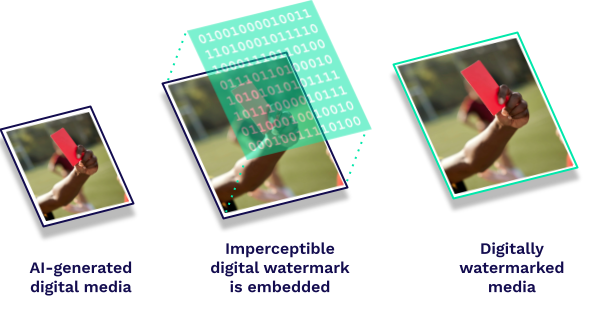

El reto clave es que estos sistemas pueden utilizarse para crear deepfakes ultrarrealistas o noticias falsas, contribuyendo a campañas de desinformación a gran escala, fraude, robo de identidad o engaño. Para contrarrestar este fenómeno, la Ley de Inteligencia Artificial (art. 50 2) establece que "los proveedores de sistemas de inteligencia artificial, incluidos los sistemas GPAI, que generen contenidos sintéticos de audio, imagen, vídeo o texto, garantizarán que los resultados del sistema de inteligencia artificial estén marcados en un formato legible por máquina y detectable como generado o manipulado artificialmente. Los proveedores garantizarán que sus soluciones técnicas sean eficaces, interoperables, sólidas y fiables en la medida en que sea técnicamente viable, teniendo en cuenta las especificidades y limitaciones de los diferentes tipos de contenidos, los costes de aplicación y el estado de la técnica generalmente reconocido, tal como pueda reflejarse en las normas técnicas pertinentes."

Una marca de agua digital obligatoria, eficaz, robusta y fiable

La obligación de transparencia va mucho más allá de una simple declaración que indique "contenido generado por IA", que puede eliminarse fácilmente, y se dirige a métodos tecnológicos sólidos y legibles por máquina para mostrar al público de forma segura que el contenido es contenido generado.

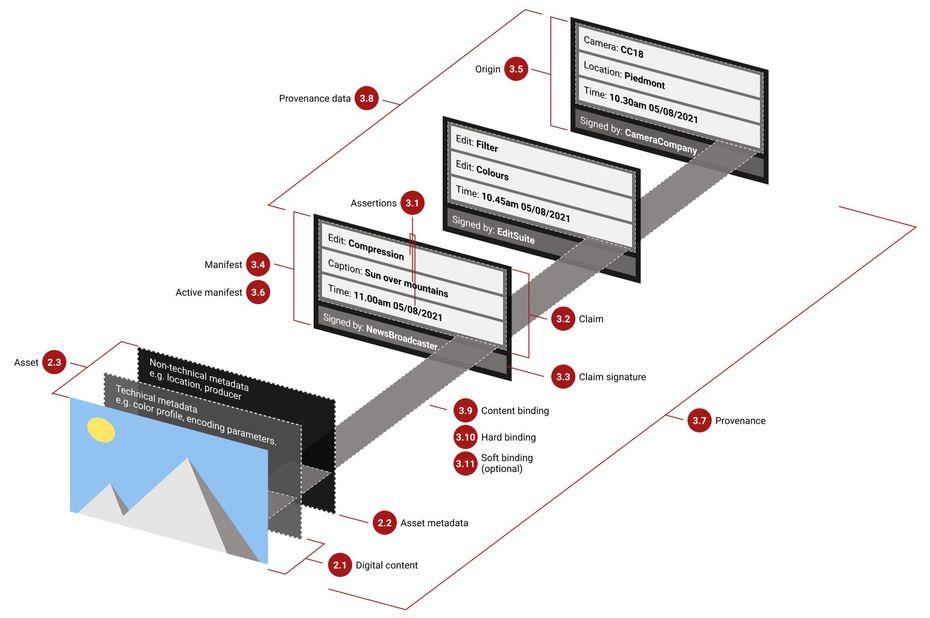

El considerando 133 de la Ley de AI establece que "dichas técnicas y métodos deben ser suficientemente fiables, interoperables, eficaces y sólidos en la medida en que sea técnicamente viable, teniendo en cuenta las técnicas disponibles o una combinación de dichas técnicas, como marcas de agua, identificaciones de metadatos, métodos criptográficos para probar la procedencia y autenticidad de los contenidos, métodos de registro, huellas dactilares u otras técnicas, según proceda".

La Oficina de Inteligencia Artificial, creada por la Ley de Inteligencia Artificial y actualmente en fase de constitución, llevará a cabo una revisión del estado del arte en este campo y definirá las normas que deberán seguir estrictamente todos los proveedores de IA generativa. Una combinación válida, actualmente al más alto nivel, podría ser la adopción de la norma C2PA, que asocia varios tipos de metadatos exclusivos del contenido (autor, fecha, sistema generativo utilizado, etc.) y los protege de toda alteración con una clave criptográfica, y asociándolos a una marca de agua digital robusta, como la de IMATAG, para impedir la supresión de estos metadatos. De este modo, el contenido queda protegido de cualquier alteración o supresión de sus metadatos y permanece perfectamente originario e íntegro durante toda su vida en la esfera informativa.

Sanciones por incumplimiento de la obligación de etiquetado

El incumplimiento de esta obligación de etiquetado conlleva automáticamente una multa de hasta 15 millones de euros o hasta el 3% del volumen de negocios total anual global alcanzado en el ejercicio financiero precedente, si esta cifra es superior.

Tiempo: el factor crucial contra los deepfakes

Los sistemas de IA de propósito general que incluyan funcionalidades de generación de contenidos sintéticos deberán cumplir la normativa antes de mayo de 2025, y todos los demás sistemas antes de mayo de 2026. Este plazo se considera muy tardío, sobre todo teniendo en cuenta que los avances tecnológicos y la adopción generalizada de sistemas de IA generativa y de propósito general, así como el ultrarrealismo de los contenidos generados, se han acelerado considerablemente en los últimos meses.

Esta preocupación por el tardío calendario de despliegue de la obligación de etiquetado de la IA generativa fue compartida recientemente por la Sra. Anna Ascani, Vicepresidenta de la Cámara de Diputados italiana, que está estudiando la adopción de una ley nacional para acelerar su despliegue. Esta reacción se produjo especialmente en respuesta a un deepfake del portavoz del presidente ucraniano, Volodymyr Zelensky, reivindicando la autoría de un atentado terrorista en Moscú, que se propagó por todas las plataformas en línea, poniendo de relieve una vez más el impacto de la desinformación debida a contenidos generados artificialmente.

El decreto presidencial estadounidense del 30 de octubre de 2023, para una inteligencia artificial segura y fiable, prevé el despliegue generalizado de marcas de agua digitales en los contenidos generados a partir de principios de 2025, mucho antes de lo que prescribe la Ley Europea de IA.

Por su parte, en la Conferencia de Seguridad de Múnich, celebrada el 16 de febrero de 2024, numerosos actores del ámbito de la IA generativa (como Anthropic, Google, Meta, Microsoft, OpenAI y Stability AI) se han comprometido en el"Acuerdo tecnológico para combatir el uso engañoso de la IA en las elecciones de 2024" a desplegar tecnologías para contrarrestar los contenidos nocivos generados por IA y destinados a engañar a los votantes, así como a detectar los contenidos generados por IA, en particular mediante marcas de agua digitales.

En este contexto de emergencia, para facilitar la transición al nuevo marco normativo, la Comisión Europea ha puesto en marcha el Pacto de la IA, una iniciativa voluntaria que pretende apoyar la futura aplicación e invita a los desarrolladores de IA de Europa y de otros lugares a cumplir por adelantado las obligaciones de la Ley de la IA y a empezar a aplicar sus requisitos antes de la fecha límite legal, incluidas las relativas a las obligaciones de marca de agua de los contenidos.

Más allá de la ley : Ética

Más allá de las obligaciones legales, ningún proveedor de IA generativa quiere que su nombre se asocie a una campaña de desinformación, fraude o manipulación de la opinión pública por razones de imagen, reputación y, en última instancia, viabilidad económica.

El etiquetado de los contenidos generados desempeña un papel crucial en la lucha contra los deepfakes y la desinformación, mitigando la sobrecarga de información para los usuarios de Internet al distinguir claramente los materiales auténticos de los generados, y apoyando los esfuerzos de alfabetización mediática. Es una cuestión de responsabilidad y ética, como ha puesto de relieve recientemente la resolución no vinculante de la Asamblea General de la ONU del 21 de marzo de 2024, patrocinada por Estados Unidos y copatrocinada por 123 países, entre ellos China, que definitivamente lleva el etiquetado de los contenidos generados al campo de la ética, antes de que entre en el del puro cumplimiento legal.

Proveedores de IA generativa de todos los países, ¡no esperen para marcar sus contenidos generados con la tecnología de IMATAG, una de las más robustas y seguras del mundo!

Foto : Imagen generada por IA que cumple la normativa C2PA.

¿Quiere "ver" una Marca de Agua Invisible?

Obtenga más información sobre la solución de IMATAG para insertar marcas de agua invisibles en sus contenidos visuales.

Reservar una demostraciónEstos artículos también pueden interesarle

Autenticidad y detección de IA

5 de marzo de 2024

Marca de agua incrustada: cómo garantizan los fabricantes la autenticidad digital en el punto de captura

Autenticidad y detección de IA

14 de marzo de 2024

Integración de la marca de agua en las normas C2PA: Imprescindible para la autenticidad de los contenidos en línea

Autenticidad y detección de IA

29 de enero de 2024